Sistema de monitoreo de conductores de vehículos a partir de análisis de expresiones faciales

DOI:

https://doi.org/10.17981/ingecuc.16.2.2020.14Palabras clave:

inteligencia artificial, aprendizaje de máquina, aprendizaje profundo, visión artificial, expresiones facialesResumen

Introducción-Al conducir, la persona se encuentra expuesta a diferentes estímulos que pueden llevar a que se ocasione accidentes. Aunque Numerosas propuestas tecnológicas se han presentado para mantener monitoreado al conductor, estas han pasado por alto el estado anímico en el que este se encuentra, el cual podría generar efectos negativos en la capacidad de reacción al conducir.

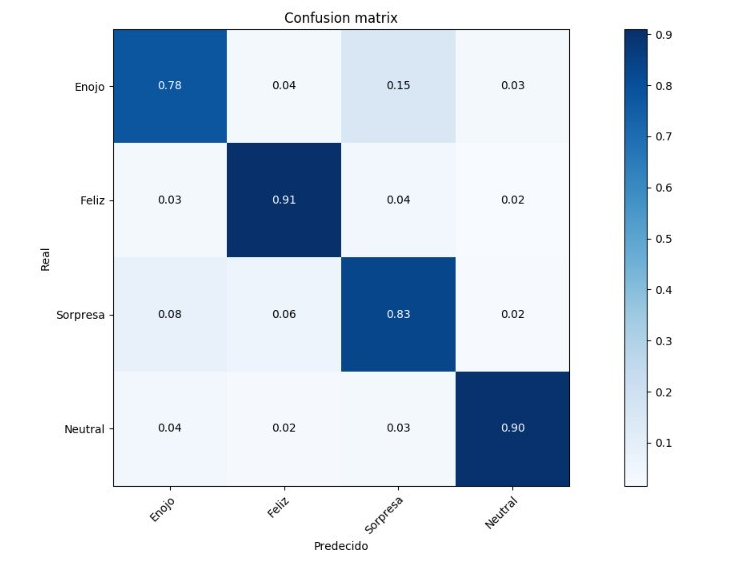

Objetivo- Buscar diferentes alternativas de inteligencia artificial para el análisis permanente de rostros de conductores, con el fin de encontrar un buen modelo de clasificación de expresión facial (feliz, enojo, sorpresa, neutral).

Metodología- La metodología utilizada consiste en la selección de una base de datos que es preprocesada, para posteriormente entrenar diferentes modelos y realizar comparaciones de precisión entre ellos.

Resultados- Se logra encontrar una precisión mayor al 80% en la detección del estado anímico del usuario. Y se logra migrar el modelo a un sistema de monitoreo portátil.

Conclusiones- En este caso particular los métodos de aprendizaje de maquina tradicionales (machine learning) consumen menos tiempo a la hora de clasificar, sin embargo, estos son superados en precisión por un aprendizaje profundo.

Descargas

Citas

A. González, F. J. Martínez, A. V. Pernía, F. A. Elías, M. Castejón, J. Ordieres & E. Vergara, Técnicas y Algoritmos Básicos de Visión Artificial. RI, Es.: U de la Rioja, 2006.

F. Chollet, “Deep Learning With Python” Vol. 1, GMT, USA: Manning Publications Co, 2017.

V. Torres & J. Alejandra, “Las Compañías más Grandes en Seguros Generales en Colombia: Un Análisis Comparativo en el Período 2015-2017,” Trabajo de grado, UC, Bog., Co., 2017.

W. Arias & S. B. Chaves, “Analysis Of Fatalities For Crash Accidents in Colombia Between 2011-2015,” Redes de Ingenieria-Rompiendo las Barreras del Conocimiento, vol. Especial, pp. 226–239, 2017. Available: http://revistas.udistrital.edu.co/ojs/index.php/REDES/index

E. G. Fernández-Abascal & M. Chóliz, Expresión Facial de la Emoción, Mad., Esp.: UNED, 2001.

A. Freitas-Magalhães, Facial Action Coding System-Manual of Scientific Codification of the Human Face. RJ. Br.: Escrytos, 2018.

R. Amini, C. Lisetti & G. Ruiz , “Hapfacs 3.0: Facs-Based Facial Expression Generator for 3d Speaking Virtual Characters,”IEEE Trans Affect Comput, vol. 6, no 4, pp. 348–360, 2015. https://doi.org/10.1109/TAFFC.2015.2432794

E. A. Morris & J. A. Hirsch, “Does Rush Hour See A Rush Of Emotions? Driver Mood in Conditions Likely To Exhibit Congestion,” Travel Behav Soc, vol. 5, pp. 5–13, Sep. 2016. https://doi.org/10.1016/j.tbs.2015.07.002

A. Carneiro, P. Cortez & R. Costa, Reconhecimento de Gestos da Libras com Classificadores Neurais a Partir dos Momentos Invariantes de Hu, in Interaction Sudamerica/09SP. Br.: IXTA-SP, pp. 193–198, 2009.

M. G. Kamachi, J. Gyoba & M. J. Lyoons, “The Japanese Female Facial Expression (Jaffe) Database, in “Proceedings of Third International Conference on Automatic Face and Gesture Recognition,” Data Set, Zenodo, pp. 14–16, 14 Abr. 1998. https://doi.org/10.5281/zenodo.3451524

C. E. Thomaz, “Fei Face Database,” Fei Face Databaseavailable, 2012. Available: https://fei.edu.br/~cet/facedatabase.html

S. Li, W. Deng & J. P. Du, “Reliable Crowdsourcing And Deep Locality-Preserving Learning For Expression Recognition In The Wild,” presented at Proceedings of the Ieee Conference on Computer Vision and Pattern Recognition, CVPR, Hnl., Hi., USA, pp. 2852–2861, 21-26 Jul. 2017. https://doi.org/10.1109/CVPR.2017.277

N. Pellejero, G. L. Grinblat & U. Lucas, “Análisis Semántico en Rostros Utilizando Redes Neuronales Profundas,” presentado al XVIII Simposio Argentino de Inteligencia Artificial, ASAI-JAIIO 46, Cord., Arg., pp. 62–71, Sept. 2017. Disponible en http://sedici.unlp.edu.ar/handle/10915/65945

M. Köstinger, P. Wohlhart, P. M. Roth & H. Bischof, “Annotated Facial Landmarks In The Wild: A Large-Scale, Real-World Database for Facial Landmark Localization,” en 2011 IEEE International Conference on Computer Vision Workshops, ICCV Workshops, Bcn., Es., pp. 2144–2151, 6-13 Nov, 2011. https://doi.org/10.1109/ICCVW.2011.6130513

S. Marsland, Machine Learning: An Algorithmic Perspective, 2. Ed., CRC Press, Br. Fl. USA, 2015. https://doi.org/10.1201/b17476

K. Simonyan & A. Zisserman, “Very Deep Convolutional Networks For Large-Scale Image Recognition,” Arxiv Preprint, ICLR, Baff., Ca., pp. 1409–1556, 2014. Available: https://arxiv.org/pdf/1409.1556.pdf

R. S. Jurecki, T. L. Stańczyk & M. J. Jaśkiewicz, “Driver’s Reaction Time In A Simulated, Complex Road Incident,” Transport, vol. 32, no. 1, pp. 44–54, 2017. https://doi.org/10.3846/16484142.2014.913535

B. C. C. Cerezo & E. I. Ortega, “Diseño de un prototipo de casilleros inteligentes, utilizando el carnet universitario y clave de seguridad para el control de acceso a través de una red inalámbrica, mediante la administración de página web y base de datos aplicando tecnología de bajo costo (raspberry y arduino), para beneficio de los estudiantes de la carrera de ingeniería en networking y telecomunicaciones de la Universidad de Guayaquil,” tesis grado, dpto. FCFM, UG, Gquil., Ec., 2018. Disponible en http://repositorio.ug.edu.ec/handle/redug/32565

Publicado

Cómo citar

Número

Sección

Licencia

Derechos de autor 2020 INGE CUC

Esta obra está bajo una licencia internacional Creative Commons Atribución-NoComercial-SinDerivadas 4.0.

Los artículos publicados son de exclusiva responsabilidad de sus autores y no reflejan necesariamente las opiniones del comité editorial.

La Revista INGE CUC respeta los derechos morales de sus autores, los cuales ceden al comité editorial los derechos patrimoniales del material publicado. A su vez, los autores informan que el presente trabajo es inédito y no ha sido publicado anteriormente.

Todos los artículos están bajo una Licencia Creative Commons Atribución-NoComercial-SinDerivadas 4.0 Internacional.

English

English

Español (España)

Español (España)